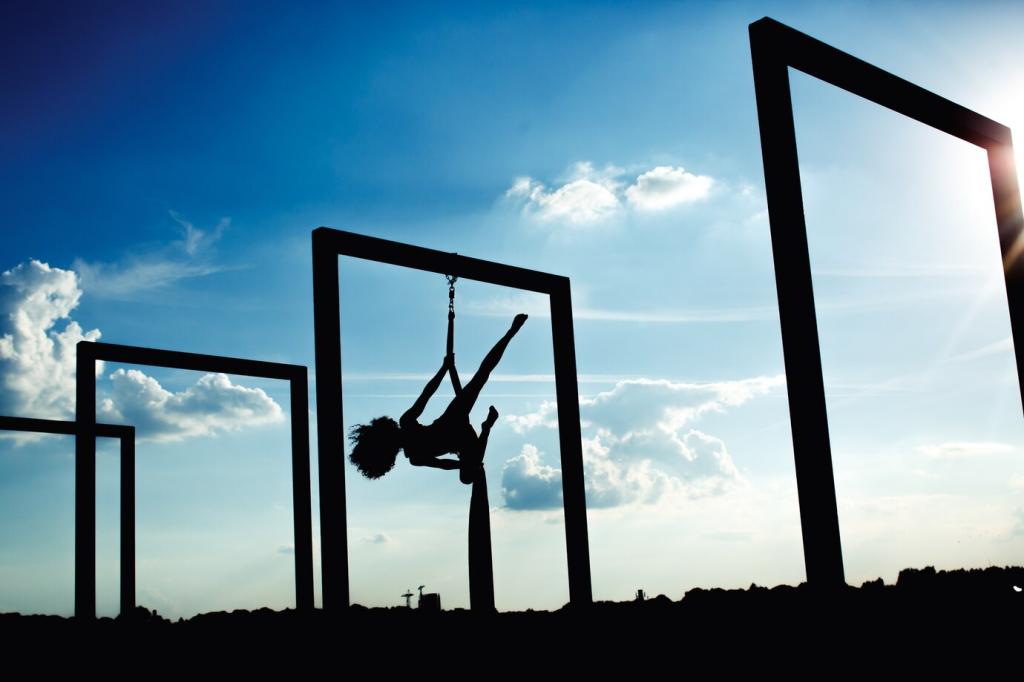

Ethische Überlegungen in der KI-Entwicklung: Verantwortung als Kompass

Gewähltes Thema: Ethische Überlegungen in der KI-Entwicklung. Willkommen auf unserer Startseite, auf der wir zeigen, wie Werte, Transparenz und Empathie aus Algorithmen wirkliche Vertrauensmaschinen machen. Erzählen Sie uns Ihre Sicht, stellen Sie Fragen und abonnieren Sie für tiefere Einblicke!

Verantwortung von Anfang an: Ethik als Projektrahmen

Ethik beginnt im Backlog

Wenn Risiken, Betroffene und gesellschaftliche Auswirkungen schon im Backlog sichtbar sind, verändert sich jede Priorisierung. Ein Team, das Ethik-User-Stories pflegt, entdeckt blinde Flecken früher und spart später kostspielige Kurskorrekturen ein.

Rollen und Rechenschaft

Klare Verantwortlichkeiten verhindern ethische Diffusion. Eine benannte Person für Risikoabschätzung und Stakeholder-Dialog schafft Verbindlichkeit, fördert Lernschleifen und stärkt das Vertrauen der Nutzerinnen und Nutzer in jede Veröffentlichung.

Fairness und Bias: Von der Datenquelle bis zur Auswertung

Ein anonymes Start-up berichtete, wie ein vermeintlich riesiger Datensatz kaum ältere Menschen abbildete. Erst durch gezielte Nachsammlung und strenge Stichprobenkontrollen verbesserten sich Fehlerraten für benachteiligte Gruppen signifikant.

Fairness und Bias: Von der Datenquelle bis zur Auswertung

Konfusionsmatrizen nach Subgruppen, Demografie-parität, Equalized Odds und Gegenfaktoren helfen, Ungleichheiten aufzudecken. Teilen Sie Ihre Lieblingsbibliotheken und diskutieren Sie, welche Schwellenwerte in Ihrer Domäne sinnvoll sind.

Erklärbare Modelle in der Praxis

SHAP, LIME und Gegenfaktische Erklärungen sind hilfreich, doch Zielgruppen unterscheiden sich. Eine Ärztin braucht klinische Evidenz, ein Patient verständliche Analogien. Gute Erklärungen sind präzise, kontextbezogen und ehrlich über Unsicherheiten.

Dokumentation als Brücke

Model Cards, Datasheets for Datasets und Decision Logs bilden den roten Faden. Sie zeigen Annahmen, Grenzen und Updates. Kommentieren Sie, welche Templates Ihnen helfen, die Story Ihrer Modelle lückenlos zu erzählen.

Grenzen der Transparenz

Nicht jedes Detail darf offengelegt werden: Geschäftsgeheimnisse, Sicherheit und Missbrauchsrisiken setzen Grenzen. Offenheit heißt deshalb auch: Klar benennen, was nicht geteilt wird, warum, und welche Alternativen der Einsicht bestehen.

Datenschutz und Einwilligung: Würde in jedem Bit

01

Datensparsamkeit, Edge-Verarbeitung und strikte Zweckbindung reduzieren Risiken. Wenn der Zweck erweitert wird, braucht es neue Einwilligungen. So bleibt die Kontrolle über Daten bei den Menschen, denen sie gehören.

02

Klarheit schlägt Juristendeutsch. Verständliche Erklärungen, granulare Wahlmöglichkeiten und leicht widerrufbare Zustimmungen schaffen echte Autonomie. Fragen Sie Ihre Nutzerinnen und Nutzer, ob sie die Konsequenzen wirklich begreifen.

03

Differential Privacy, k-Anonymität und Synthetik sind mächtig, aber nicht narrensicher. Re-Identifikationsrisiken müssen regelmäßig neu bewertet werden, besonders bei Kombination mehrerer Datenquellen im selben Ökosystem.

Sicherheit, Robustheit und Missbrauchsprävention

Red-Teaming als Realitätstest

Strukturiertes Red-Teaming deckt Prompt-Injektionen, Datenvergiftungen und Jailbreaks auf. Teams berichten, dass gemeinsame Übungen nicht nur Schwachstellen finden, sondern auch Sicherheitskultur und cross-funktionales Verständnis stärken.

Sichere Auslieferung und Monitoring

Feature-Flags, Guardrails, Rate-Limits und Moderationspipelines verhindern Eskalationen. Kontinuierliches Monitoring erkennt Drift und Missbrauch frühzeitig. Teilen Sie, welche Metriken und Alarmierungen sich bei Ihnen bewährt haben.

Missbrauchsszenarien durchspielen

Threat Modeling mit „Was wäre, wenn?“-Szenarien zeigt ungewollte Nebenwirkungen. Ein Team verhinderte so, dass ein hilfreicher Assistent zur Desinformationsschleuder wurde. Vordenken ist günstiger als Aufräumen nach dem Vorfall.

Mensch im Mittelpunkt: Aufsicht, Arbeit und Kompetenzen

Wirksame menschliche Aufsicht

Aufsicht bedeutet Befugnis, Zeit und Wissen, tatsächlich einzugreifen. Ein Krankenhausprojekt senkte Fehlalarme, indem Pflegekräfte Annotationsrechte erhielten und Feedback-Schleifen sichtbar in die Modellupdates einflossen.

Governance, Normen und globale Perspektiven

Der EU AI Act, ISO/IEC 23894 und das NIST AI RMF helfen, Risiken systematisch zu managen. Entscheidend ist, Prinzipien in tägliche Checklisten, Gates und Release-Kriterien zu überführen.

Governance, Normen und globale Perspektiven

Ethische Erwartungen variieren global. Partizipative Prozesse mit lokalen Communities verhindern kulturelle Blindheit. Berichten Sie, wie Sie internationale Perspektiven in Designentscheidungen integrieren.